什么是Flume?

flume 作为 cloudera 开发的实时日志收集系统,受到了业界的认可与广泛应用。Flume 初始的发行版本目前被统称为 Flume OG(original generation),属于 cloudera。但随着 FLume 功能的扩展,Flume OG 代码工程臃肿、核心组件设计不合理、核心配置不标准等缺点暴露出来,尤其是在 Flume OG 的最后一个发行版本 0.94.0 中,日志传输不稳定的现象尤为严重,为了解决这些问题,2011 年 10 月 22 号,cloudera 完成了 Flume-728,对 Flume 进行了里程碑式的改动:重构核心组件、核心配置以及代码架构,重构后的版本统称为 Flume NG(next generation);改动的另一原因是将 Flume 纳入 apache 旗下,cloudera Flume 改名为 Apache Flume。

flume的特点

flume是一个分布式、可靠、和高可用的海量日志采集、聚合和传输的系统。支持在日志系统中定制各类数据发送方,用于收集数据;同时,Flume提供对数据进行简单处理,并写到各种数据接受方(比如文本、HDFS、Hbase等)的能力 。

flume的数据流由事件(Event)贯穿始终。事件是Flume的基本数据单位,它携带日志数据(字节数组形式)并且携带有头信息,这些Event由Agent外部的Source生成,当Source捕获事件后会进行特定的格式化,然后Source会把事件推入(单个或多个)Channel中。你可以把Channel看作是一个缓冲区,它将保存事件直到Sink处理完该事件。Sink负责持久化日志或者把事件推向另一个Source。

flume的可靠性

当节点出现故障时,日志能够被传送到其他节点上而不会丢失。Flume提供了三种级别的可靠性保障,从强到弱依次分别为:end-to-end(收到数据agent首先将event写到磁盘上,当数据传送成功后,再删除;如果数据发送失败,可以重新发送。),Store on failure(这也是scribe采用的策略,当数据接收方crash时,将数据写到本地,待恢复后,继续发送),Besteffort(数据发送到接收方后,不会进行确认)。

flume的可恢复性

还是靠Channel。推荐使用FileChannel,事件持久化在本地文件系统里(性能较差)。

flume的一些核心概念

Agent 使用JVM 运行Flume。每台机器运行一个agent,但是可以在一个agent中包含多个sources和sinks。

Client 生产数据,运行在一个独立的线程。

Source 从Client收集数据,传递给Channel。

Sink 从Channel收集数据,运行在一个独立线程。

Channel 连接 sources 和 sinks ,这个有点像一个队列。

Events 可以是日志记录、 avro 对象等。

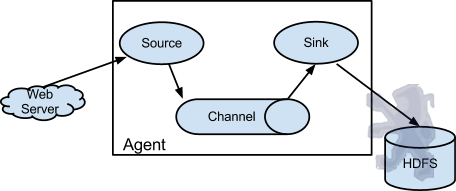

Flume以agent为最小的独立运行单位。一个agent就是一个JVM。单agent由Source、Sink和Channel三大组件构成,如下图:

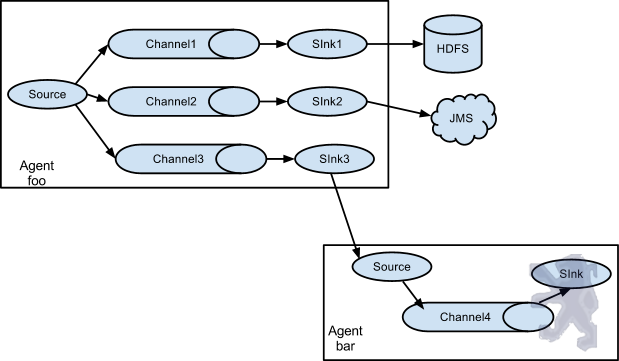

值得注意的是,Flume提供了大量内置的Source、Channel和Sink类型。不同类型的Source,Channel和Sink可以自由组合。组合方式基于用户设置的配置文件,非常灵活。比如:Channel可以把事件暂存在内存里,也可以持久化到本地硬盘上。Sink可以把日志写入HDFS, HBase,甚至是另外一个Source等等。Flume支持用户建立多级流,也就是说,多个agent可以协同工作,并且支持Fan-in、Fan-out、Contextual Routing、Backup Routes,这也正是NB之处。如下图所示:

flume的官方网站在哪里

如何安装?

1、 官网下载flume安装包,地址:https://flume.apache.org/download.html

如下表所示:

Apache Flume binary (tar.gz) | |

Apache Flume source (tar.gz) |

解压文件 ## tar -zxvf apache-flume-1.6.0-bin.tar.gz 进入文件目录 ## cd apache-flume-1.6.0-bin/ 复制环境变量 ## cp conf/flume-env.sh.template conf/flume-env.sh 编辑环境变量 ## vi conf/flume-env.sh export JAVA_HOME=/usr/local/jdk1.7.0_80 查看安装版本 ## ./bin/flume-ng version Flume 1.6.0 Source code repository: https://git-wip-us.apache.org/repos/asf/flume.git Revision: 2561a23240a71ba20bf288c7c2cda88f443c2080 Compiled by hshreedharan on Mon May 11 11:15:44 PDT 2015 From source with checksum b29e416802ce9ece3269d34233baf43f 如有异常 vi bin/flume-ng export JAVA_HOME=/usr/local/jdk1.7.0_80 再次查看安装版本 到这里已经基本安装完成了

flume的案例

Flume avro + logs 案例

添加配置文件

vi conf/avro.conf

a1.sources = r1 a1.sinks = k1 a1.channels = c1 # Describe/configure the source a1.sources.r1.type = avro a1.sources.r1.channels = c1 a1.sources.r1.bind = 0.0.0.0 a1.sources.r1.port = 4141 # Describe the sink a1.sinks.k1.type = logger # Use a channel which buffers events in memory a1.channels.c1.type = memory a1.channels.c1.capacity = 1000 a1.channels.c1.transactionCapacity = 100 # Bind the source and sink to the channel a1.sources.r1.channels = c1 a1.sinks.k1.channel = c1

启动flume agent a1

./bin/flume-ng agent -c conf/ -f conf/avro.conf -n a1 -Dflume.root.logger=INFO,console

创建日志文件

echo "hello world" > log.00

启动客户端

./bin/flume-ng avro-client -c ./conf -H 127.0.0.1 -p 4141 -F log.00

agent控制台可以看到

2016-03-22 17:20:35,464 (SinkRunner-PollingRunner-DefaultSinkProcessor) [INFO - org.apache.flume.sink.LoggerSink.process(LoggerSink.java:94)] Event: { headers:{} body: 68 65 6C 6C 6F 20 77 6F 72 6C 64 hello world }

2016-03-22 17:20:35,487 (New I/O worker #1) [INFO - org.apache.avro.ipc.NettyServer$NettyServerAvroHandler.handleUpstream(NettyServer.java:171)] [id: 0xc76cc890, /127.0.0.1:44061 :> /127.0.0.1:4141] DISCONNECTED

2016-03-22 17:20:35,487 (New I/O worker #1) [INFO - org.apache.avro.ipc.NettyServer$NettyServerAvroHandler.handleUpstream(NettyServer.java:171)] [id: 0xc76cc890, /127.0.0.1:44061 :> /127.0.0.1:4141] UNBOUND

2016-03-22 17:20:35,487 (New I/O worker #1) [INFO - org.apache.avro.ipc.NettyServer$NettyServerAvroHandler.handleUpstream(NettyServer.java:171)] [id: 0xc76cc890, /127.0.0.1:44061 :> /127.0.0.1:4141] CLOSED

2016-03-22 17:20:35,488 (New I/O worker #1) [INFO - org.apache.avro.ipc.NettyServer$NettyServerAvroHandler.channelClosed(NettyServer.java:209)] Connection to /127.0.0.1:44061 disconnected.注:启动agent可能出现错误,一般都是java环境变量导致

Flume sink kafka + logs 案例

a1.sources=r1 a1.sinks=k1 a1.channels=c1 # Describe/configure the source a1.sources.r1.type=exec a1.sources.r1.channels=c1 a1.sources.r1.command=tail -n 0 -F /home/zbtest/apache-tomcat-7.0.12/logs/catalina.out # Describe the sink a1.sinks.k1.type=org.apache.flume.sink.kafka.KafkaSink a1.sinks.k1.topic=mytopic a1.sinks.k1.brokerList=localhost:9092 a1.sinks.k1.requiredAcks=1 a1.sinks.k1.batchSize=20 # Use a channel which buffers events in memory a1.channels.c1.type=memory a1.channels.c1.capacity=1000 a1.channels.c1.transactionCapacity=100 # Bind the source and sink to the channel a1.sources.r1.channels=c1 a1.sinks.k1.channel=c1